21 luglio 2023

L’importanza del farsi le giuste domande

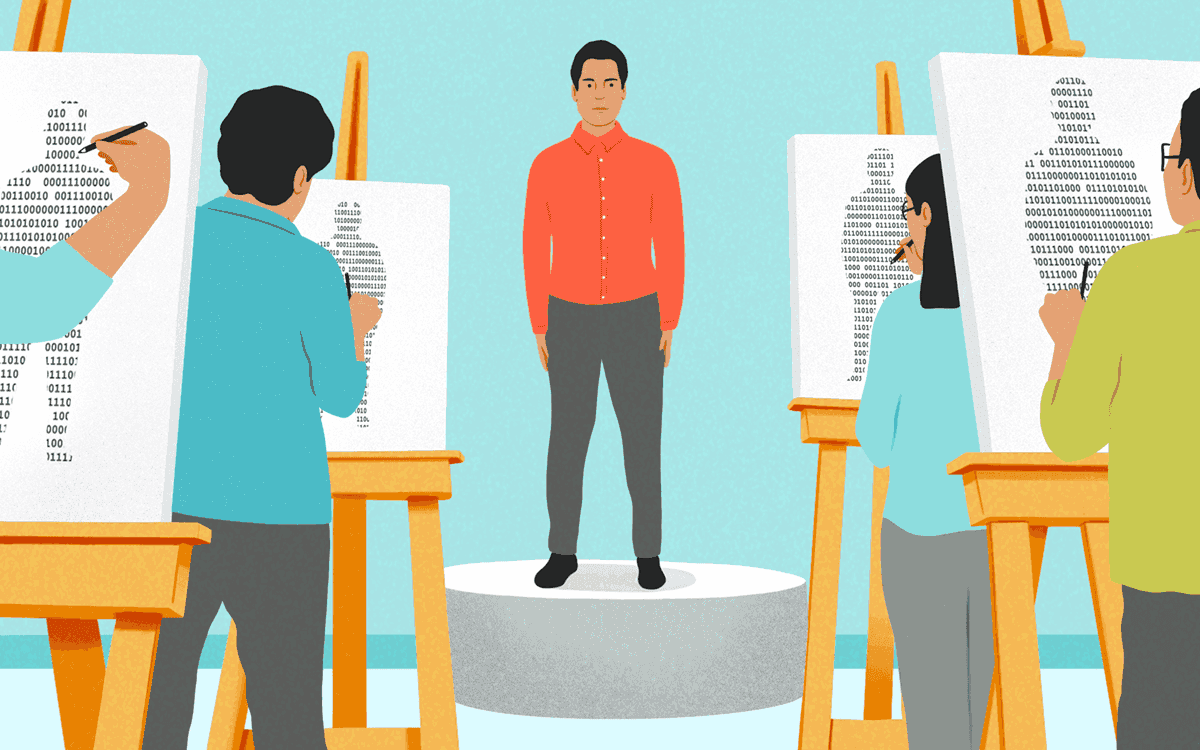

Il percorso di PagoPA verso un centro di competenze interno per la tutela dei diritti dei cittadini in ogni fase della progettazione dei servizi digitali

PagoPA è una tech company in prima fila nel processo di trasformazione digitale dei servizi pubblici in Italia: questo ci pone il dovere di farci continuamente le giuste domande sulla natura dei servizi che sviluppiamo, l’impatto che hanno sulla vita delle persone, sui diritti dei cittadini a cui sono rivolti.

Questa attenzione, sin dalla nascita della società, si è concretizzata in un continuo dialogo tra le principali anime che lavorano alla realizzazione dei nostri progetti:

- il team di design, che intercetta e identifica i bisogni delle persone e traccia la strada per tradurli in servizi che abbiano un effettivo valore aggiunto;

- il team engineering, che valuta la fattibilità tecnica e la scalabilità dei servizi, e stabilisce cosa si può realizzare e cosa no, valutando anche temi come la sicurezza;

- il team legale, che si interroga su come il funzionamento di questi servizi interagisca con la sfera dei diritti del cittadino.

La sfida della nostra società è sempre stata quella di far interagire queste anime in ogni fase dei processi decisionali e di sviluppo, dall’ideazione alla realizzazione dei progetti, attraverso team multidisciplinari che includono esperti con diverse competenze e sensibilità.

Con lo stesso scopo lavoriamo attivamente per favorire la commistione delle competenze tra i singoli professionisti dei vari team, che permette a ognuno di acquisire la giusta familiarità e sensibilità sulle istanze degli altri. Una permeabilità culturale che oggi stiamo rendendo strutturale, per essere sempre capaci di guardare ai nostri progetti da prospettive diverse e domandarci quali effetti hanno, per garantire che la tecnologia sia a supporto delle persone e assicurarci che i diritti siano tutelati nell’offerta del servizio.

Continua a leggere

Launch Pad

I dati da cui partire, sempre

28%

delle grandi imprese già nel 2021 usava abitualmente sistemi di Intelligenza Artificiale, secondo i più recenti dati Eurostat, in particolare per servizi di informazione e comunicazione, con una maggiore penetrazione in Danimarca, Portogallo, Finlandia. Il 53% delle imprese che hanno usato sistemi di IA si sono affidati a software commerciali pronti all’uso.

Guest Post

Ospiti, opinioni, best practice

La strada per un’intelligenza artificiale che metta al centro le persone

Conversazione con Ben A. Shneiderman, Distinguish Professor of Computer Science all’Università del Maryland e autore di Human-Centered AI, Oxford University Press (2022)

Esiste un gap di competenze digitali nella Pubblica Amministrazione?

I più rosei sogni e i peggiori incubi riguardo l’Intelligenza Artificiale che vengono rappresentati nella cultura popolare attraverso libri, giochi e film, evocano immagini di progressi incredibili o di prospettive terrificanti. In entrambi i casi, le persone non hanno più il controllo: le macchine decidono e governano in autonomia. In realtà esiste una terza via, un futuro alternativo dove gli apparecchi digitali amplificano enormemente le capacità dell’uomo senza però prendere il controllo. Questa prospettiva è detta Human-Centered Artificial Intelligence (HCAI): permette alle persone di vedere, pensare, creare e agire in modo straordinario, attraverso delle esperienze utente che nascondono servizi basati sull’IA.

Esistono precise raccomandazioni per realizzare una Intelligenza Artificiale Human-Centered e chiudere il cerchio tra etica e applicazioni pratiche. Un diverso modo di pensare che può portare, in futuro, ad applicazioni dell’IA più sicure, comprensibili e gestibili. Un approccio Human-Centered ha lo scopo di ridurre i rischi legati a tecnologie fuori controllo, alle ricadute occupazionali, alla privacy o alla sicurezza, e di dare più forza ai valori umani, rispettare la dignità dell’uomo, mettere al centro le capacità delle persone che permettono scoperte e invenzioni basate sulla creatività.

Continua a leggere

Pick the news

Spunti di attualità

L’improvvisa popolarità di sistemi di Intelligenza Artificiale disponibili per il pubblico, in particolare ChatGPT, secondo quanto riferisce Politico sta creando non pochi grattacapi ai policy makers di Bruxelles, che già lo scorso dicembre avevano trovato un primo accordo sull’AI Act, la normativa Europea per garantire che l'intelligenza artificiale “rispetti i diritti fondamentali” dei cittadini. Il dibattito, che coinvolge politici, Ong e gruppi come Google o Microsoft, si interroga sull’inserire “sistemi di IA che generano testi complessi senza monitoraggio dell’uomo” tra i servizi classificati “ad alto rischio” dalla nascente normativa, rendendoli pertanto molto più normati.

Classificare un elevato numero di servizi “ad alto rischio” potrebbe, però, favorire la concentrazione del mercato, secondo quanto emerso in un convegno di Euractiv sui rischi per le Piccole e medie imprese legati all’AI Act. Il timore espresso è che la Commissione abbia sottovalutato il costo di compliance a carico delle imprese, che potrebbe permettere lo sviluppo e l’utilizzo di servizi di IA solo a chi può permettersi grandi economie di scala.